18.10.2025 - 21:40

|

Actualització: 19.10.2025 - 13:07

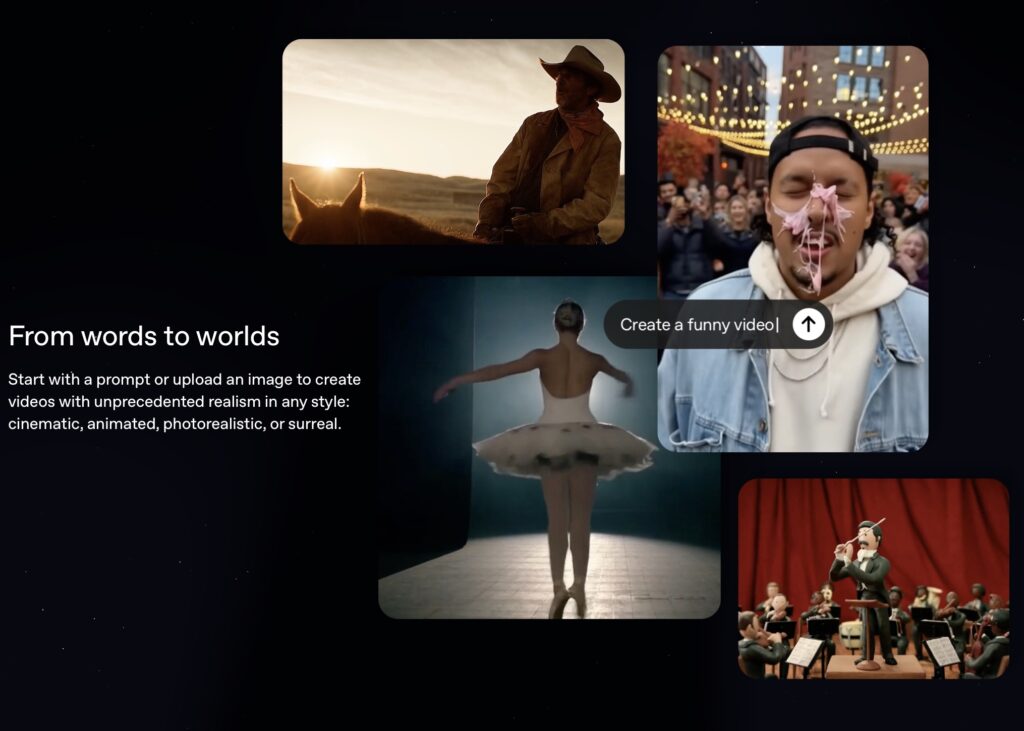

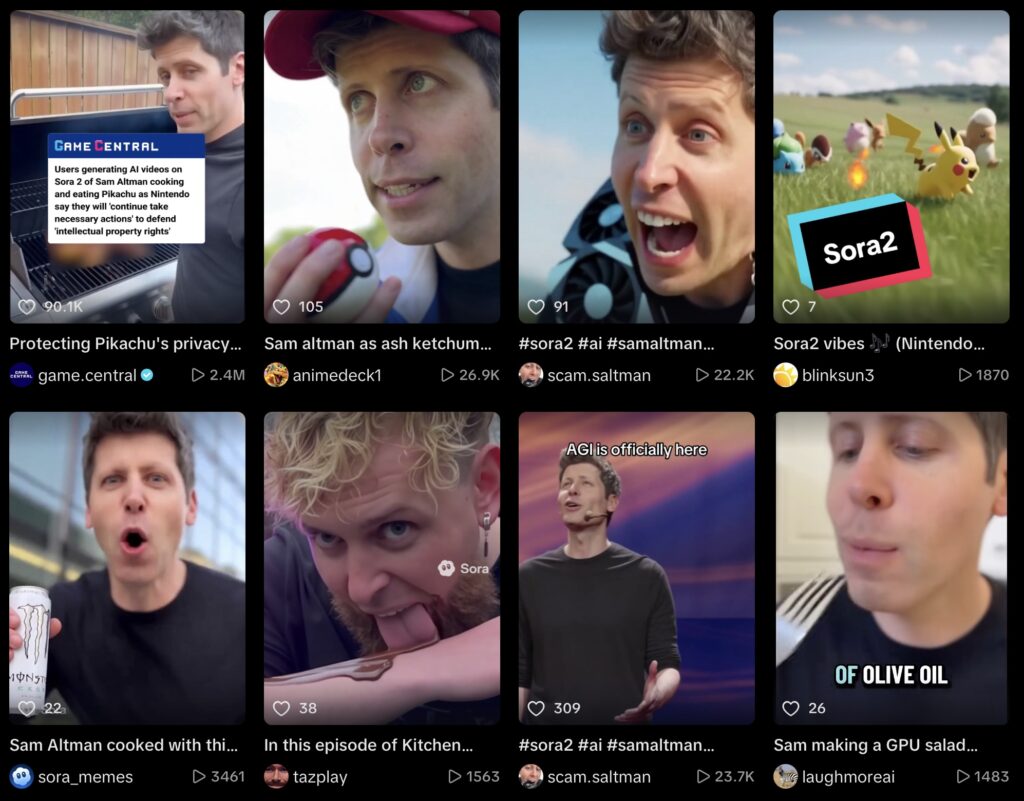

El 30 de setembre l’empresa OpenAI va presentar, tan sols per als EUA i el Canadà, la nova aplicació Sora de vídeos generats per intel·ligència artificial i que vol competir directament amb TikTok. Ràpidament, va esdevenir l’aplicació de més èxit dels EUA, amb més d’un milió de descàrregues malgrat ser accessible només per invitació. Aquestes xifres han superat el llançament del ChatGPT. Com en els productes anteriors de la companyia, la polèmica també ha acompanyat Sora. El vídeo de promoció era protagonitzat per una versió sintètica del màxim responsable d’OpenAI, Sam Altman, acompanyat de personatges de Pokémon i Nintendo. I es presentava sense cap llicència d’ús d’aquests personatges i, per tant, infringint les lleis de copyright. També ha deixat glaçat molta gent l’extrem realisme de les imatges artificials, indistingibles de les reals, cosa que deixa camp adobat a la manipulació i la desinformació. La companyia assegura que ha introduït mesures de seguretat per evitar-ho. Tot seguit analitzem la polèmica i quin paper pot ocupar Sora en els plans generals d’OpenAI.

Fer una versió sintètica de nosaltres mateixos

L’aplicació Sora fa servir el nom del model d’àudio i vídeo de la companyia, que s’havia presentat a final del 2024 també restringit als EUA i al Canadà. En aquests dos països els usuaris de pagament de ChatGPT ja podien fer servir Sora a partir d’aquella data. En canvi, a la UE no és disponible per la regulació digital de la Unió, que mira de regular el sector per protegir els consumidors, malgrat que és fortament criticat per les companyies nord-americanes. Sora tampoc no és disponible a la UE, ni hi ha cap data oficial de llançament, ara per ara. Un segon motiu per a aquesta disponibilitat restringida, inclòs el mecanisme d’invitació a l’Amèrica del Nord, podria ser la potència de càlcul que necessita la creació de vídeos. OpenAI està en procés de construir nous centres de dades per a ampliar aquesta potència.

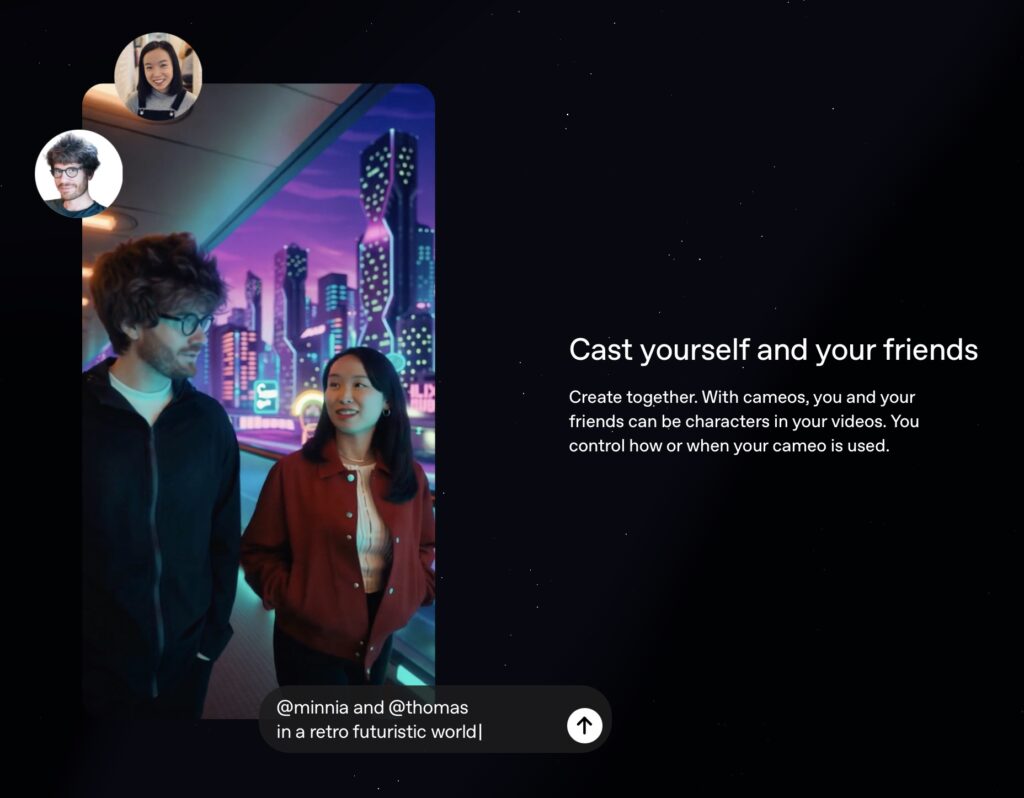

Juntament amb la nova aplicació, OpenAI presentava la segona generació del model, el Sora 2. Segons la companyia, el nou model és millor seguint les lleis de la física, amb el resultat de vídeos més realistes. Ara el comportament de pilotes de bàsquet, els moviments de persones en monopatí o les acrobàcies gimnàstiques, per exemple, són més naturals. L’aplicació té una estructura i unes opcions molt semblants a la de TikTok, per donar un component social i viralitzador al model de vídeo i àudio Sora. D’una altra banda, la nova aplicació serveix d’aparador del nou model per al sector professional, malgrat que no vagi orientada a aquest ús. Amb l’aplicació Sora podem generar qualsevol vídeo amb una petició escrita. La durada és limitada a quinze segons, i trigarà a generar-lo entre trenta segons i dos minuts. Però, malgrat l’espectacularitat dels vídeos generats, la funcionalitat que més ha cridat l’atenció és la que la companyia anomena “Cameo”. L’aplicació fa un escannatge de la nostra cara per a fer una versió sintètica de nosaltres. A partir d’aquell moment podrem generar vídeos en què sortirem nosaltres fent qualsevol situació que demanen per text. Per seguretat, tots els vídeos de Sora duen una marca d’aigua per a identificar que és contingut generat amb IA i no pas imatges reals.

A més, podem decidir si compartim amb uns altres usuaris la nostra versió sintètica perquè puguin generar vídeos amb nosaltres. Poden ser persones concretes que vulguem (com ara amics o familiars), gent que seguim i alhora ens segueixen (seguiment mutu) o absolutament tothom. Podem modificar la llista de persones autoritzades a emprar el nostre cameo en tot moment. Si decidim que el pugui fer servir tothom (com en el cas de Sam Altman) OpenAI afirma que “restarà subjecte a les normes de la plataforma”, sense especificar-les. Igualment, la companyia assegura que podem suprimir els vídeos que generin uns altres usuaris amb la nostra versió sintètica, si no ens agraden o considerem que són inapropiats.

La polèmica dels drets d’autor i una mesures de seguretat ineficaces

Com hem dit, per seguretat, els vídeos generats amb Sora tenen una marca d’aigua ben visible que es va movent al vídeo. Una marca composta per la icona i el nom de l’aplicació. L’objectiu és que tothom que el visualitzi pugui distingir clarament que és un vídeo generat per intel·ligència artificial i se n’eviti, doncs, el mal ús. Tanmateix, el mitjà 404 Media, especialitzat en termes de seguretat, va detectar que tan sols una setmana després de la publicació de Sora ja hi havia una multitud d’aplicacions de tercers que permetien d’eliminar aquesta marca d’aigua. És a dir, tenint en compte l’extrema versemblança dels vídeos generats amb Sora, ara mateix som incapaços de distingir entre un vídeo real i un de sintètic fet amb la nova aplicació d’OpenAI.

Una altra font de polèmica és al voltant del copyright. OpenAI ja havia emprat tot de vídeos amb copyright sense pagar cap llicència d’ús per a entrenar el model de vídeo. Ara, amb la presentació de la nova aplicació, la versió sintètica de Sam Altman apareixia amb personatges de Pokémon o Bob Esponja, sense haver pagat cap llicència d’ús d’aquests personatges. La política de Sora és emprar materials amb copyright sense demanar permís. OpenAI diu que les companyies poden demanar que els seus materials no es puguin emprar a l’aplicació, però que si no el demanen explícitament OpenAI els farà servir. Aquesta pràctica, que xoca frontalment amb les lleis de copyright (en què primer cal demanar permís per a l’ús i no a l’inrevés), ja havia portat la companyia a uns quants procediments judicials amb el ChatGPT, encara pendents de resolució. Els analistes preveuen que ara amb Sora la companyia haurà de fer front a més demandes judicials.

Sam Altman ha respost a les crítiques, a tall de defensa, dient: “Molts titulars de drets estan entusiasmats amb aquesta nova interacció amb els fans i pensen que això els aportarà molt valor, però volen tenir la possibilitat d’especificar com es poden utilitzar els seus personatges (incloent-hi la possibilitat que no s’usin en absolut).” Altman també està disposat a compartir els guanys econòmics de la nova plataforma amb els titulars dels drets d’ús. La polèmica sobre el copyright no ha fet sinó començar, perquè això és una pràctica generalitzada de les companyies d’IA. Però ara afecta la potent indústria audiovisual, no tan sols la indústria editorial i els mitjans de comunicació escrits.

Tanmateix, la indústria veu la capacitat disruptiva d’aquesta nova tecnologia, i ja pensa que li servirà per a fer productes audiovisuals com ara anuncis, sèries i pel·lícules. De fet, ja hi ha hagut empreses audiovisuals que han cancel·lat inversions de centenars de milions de dòlars en ampliació d’estudis, tot esperant d’experimentar la potencialitat de la nova tecnologia. A més, OpenAI defensa que la nova eina permetrà que professionals i usuaris de fora del món audiovisual puguin expressar la creativitat en forma de vídeo, i que fins ara no ho feien per manca de coneixements tècnics o per cost econòmic.

‘Deepfakes’, la nova normalitat?

Però, més enllà de tot això, els analistes estan preocupats per l’extrema versemblança dels vídeos generats per Sora, indistingibles de la realitat. Sora fa dels deepfakes la nova normalitat, i ens fa entrar en un món distòpic. La nova tecnologia és molt polèmica de diversos punts de vista. La primera és que en el moment que l’usuari fa un escannatge de la seva cara, OpenAI té un model digital de nosaltres, amb el risc que el pugui fer servir en el futur, o que passi a mans d’unes altres companyies o de governs. O que, dins de Sora, se’n faci un mal ús que nosaltres no puguem controlar. Per exemple, si es genera un volum de vídeos tan gran amb el nostre cameo que no tinguem temps de revisar-lo.

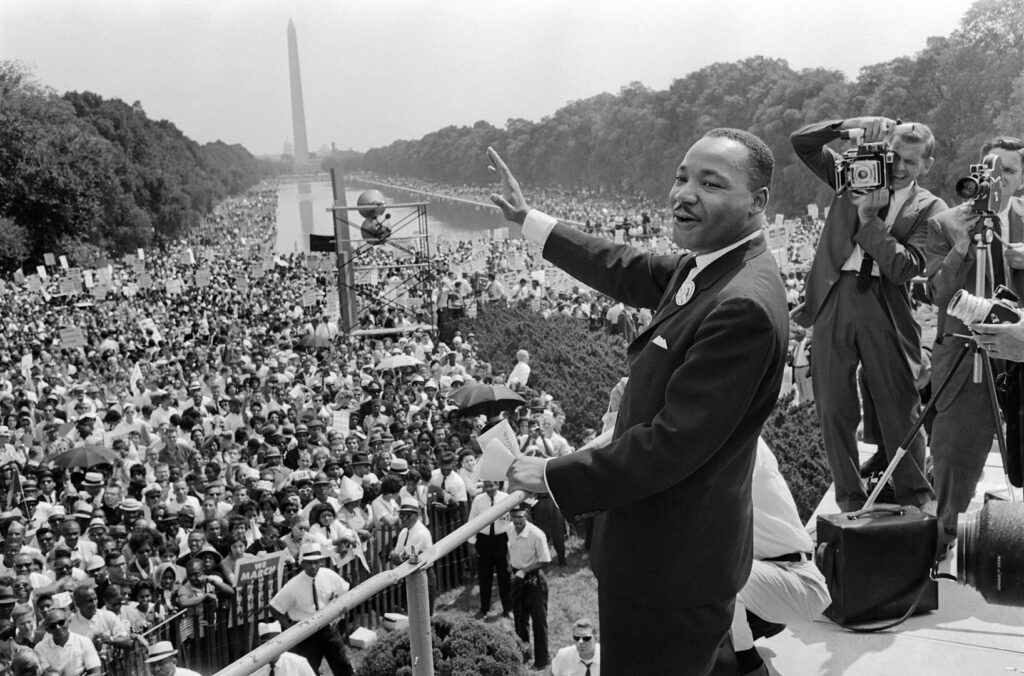

Una segona conseqüència és que, així com el cameo dels usuaris tan sols es pot fer si ells ho autoritzen, per a l’ús de la cara de persones mortes no cal autorització. Ja n’han apareguts molts amb antics presidents dels EUA, cantants com John Lennon i Michael Jackson, Martin Luther King o l’actor Robin Williams. En aquest darrer, l’ús de deepfakes de l’actor mort el 2014, ha fet que la filla demanés públicament que li deixin d’enviar vídeos generats amb IA del seu pare, per l’impacte emocional que li causa. Arran de la polèmica la companyia ha dit que els familiars de figures públiques mortes fa poc podran sol·licitar que no s’empri la seva imatge a Sora.

Una altra conseqüència té a veure amb la manipulació i la desinformació. A Sora han aparegut molts cameos amb Martin Luther King i el mític discurs “I have a dream” (‘tinc un somni’). Tenen un realisme extraordinari, imitant perfectament la qualitat d’àudio i imatge dels anys seixanta, amb una veu indistingible de l’original i una sincronització perfecta dels llavis amb les noves paraules pronunciades; es fa dir al personatge històric paraules que no va pronunciar mai. Fins i tot li fan dir el contrari, o es ridiculitza el discurs. És a dir, a partir d’ara, mirant els vídeos d’aquell discurs, no sabrem si és l’original o un trucatge. Podem fer dir a qualsevol personatge històric qualsevol cosa. Sora obre una capsa de Pandora de desinformació i manipulació que a hores d’ara ningú no sap on ens pot dur, ni tan sols OpenAI. De fet, investigadors actuals i passats de la companyia s’han manifestat públicament preocupats pel llançament de Sora 2, tot i que han dit que “faran tant com puguin per no perjudicar la humanitat”.

L’impacte sobre els més joves i contingut per a adults

Un altre efecte és l’impacte sobre els més joves. Ja se sap perfectament quins problemes psicològics originen avui les xarxes socials sobre els adolescents. Especialment la pressió estètica entre les noies. Sora introdueix un altre element de pressió, amb cossos tan perfectes com irreals. Un altre perill és el de la ridiculització de què poden ser objecte els joves amb vídeos creats per companys de classe. I allò que tothom tem: la generació de contingut pornogràfic. Aquests dies Sam Altman ha fet un anunci que ha afegit més llenya al foc: ha dit que ChatGPT permetrà contingut eròtic per a usuaris adults, de manera que es relaxaran les restriccions de seguretat en aquesta àrea que tenien els productes de la companyia. Ara com ara, es limitarà a les converses amb el bot conversacional, però no seria estrany que amb el temps això mateix s’acabi permetent també a Sora. Alhora, el màxim responsable d’OpenAI va anunciar que s’introduïa el control parental al ChatGPT, reclamat per moltes famílies, especialment després d’alguns casos de suïcidis adolescents després d’haver emprat l’eina.

Però més enllà dels casos extrems, Sora pot tenir conseqüència en què d’entrada no pensem. Per exemple, aquests dies s’han fet virals vídeos d’óssos comportant-se dòcilment amb humans, com si fossin gats o gossos. Això podria fer creure a infants i adolescents, fins i tot a algun adult, que aquest és el comportament que podem esperar d’un ós real, tot i que en realitat són molt perillosos.

OpenAI vol entrar en tots els segments del negoci electrònic

Les ambicions d’OpenAI van molt més enllà del ChatGPT o d’un Sora que vol ser el nou TikTok. La companyia sap que la IA és una tecnologia disruptiva, i ho vol aprofitar per superar les companyies que han dominat internet i la informàtica fins ara. Per una banda, treballa en un nou navegador amb la IA integrada, amb la voluntat de disputar el domini de Google Chrome. El cercador de Google també és en el punt de mira i molta gent ja fa servir la IA en compte del cercador tradicional per a trobar informació. De fet, Google i la resta de companyies tecnològiques ja donen per fet que és amb la IA com se cercarà informació a partir d’ara.

Una altra novetat anunciada per OpenAI aquests dies és que es poden executar aplicacions dins el ChatGPT. Cal tenir en compte que la companyia treballa per fer dispositius físics, i les aplicacions dins el ChatGPT seria el pas previ per a tenir un mòbil, o una eina semblant, d’OpenAI. La companyia malda per crear un ecosistema entorn del seu producte estrella, el ChatGPT, i vol emular l’èxit de les botigues d’aplicacions d’Apple i Google. De moment s’han integrat a ChatGPT aplicacions com ara Spotify, Coursera, Booking.com i Expedia. L’objectiu últim seria que ChatGPT esdevingués un sistema operatiu. L’última aplicació incorporada ha estat Walmart, la cadena de supermercats capdavantera als EUA. Ara els usuaris nord-americans hi poden fer les compres mitjançant un agent IA amb ChatGPT. És un dels altres objectius de la companyia: que ChatGPT sigui el nostre assistent personal per a les tasques diàries.

I per assolir tot això la companyia necessita molts usuaris, i si són de pagament millor. Aquests dies el ChatGPT ha superat els 800 milions d’usuaris actius setmanals, amb quatre milions de desenvolupadors treballant amb la plataforma. Per fer créixer aquestes xifres, OpenAI va crear l’estiu passat subscripcions més econòmiques a l’Índia i Indonèsia (per sota de 5 dòlars, que contrasten amb els 20 habituals). Ara ha ampliat aquest pla barat a setze països més de l’Àsia, entre els quals hi ha l’Afganistan, Timor Oriental, el Nepal, el Paquistan, les Filipines i Tailàndia, entre més. Sora és només una pota del pla de dominació mundial que impulsa Sam Altman i els altres executius d’OpenAI. I que molts experts veuen amb preocupació per la manca o relaxació de mesures de seguretat. La pregunta que es fan molts és si posen en perill la humanitat.