07.03.2026 - 21:40

Bloomberg · Parmy Olson

El mateix model de IA que us pot ajudar a redactar un correu electrònic o cercar una recepta per a fer-vos el sopar també s’ha emprat per atacar l’Iran. El Comandament Central dels Estats Units, segons una informació avançada per The Wall Street Journal, ha emprat Claude, el model de IA d’Anthropic, per fer “avaluacions d’intel·ligència, identificació d’objectius i simulació d’hipòtesis de batalla” durant els atacs d’aquests darrers dies. L’exèrcit nord-americà també emprà Claude aquest gener, durant l’operació que conduí a la captura de Nicolás Maduro.

Però què signifiquen, a la pràctica, els conceptes “avaluacions d’intel·ligència” i “identificació d’objectius”? Claude ha estat l’encarregada d’identificar quins punts calia atacar, o d’estimar les xifres de víctimes? La resposta és que no ho sabem del cert: ningú no ha revelat aquesta informació i –cosa encara més alarmant– ningú no té l’obligació de revelar-la.

El novembre passat, Anthropic s’associà amb Palantir, l’empresa d’anàlisi de dades i contractista habitual del Pentàgon, per a convertir Claude, el seu model de llenguatge gran (LLM) insígnia, en el motor del sistema de suport de presa de decisions de l’exèrcit nord-americà.

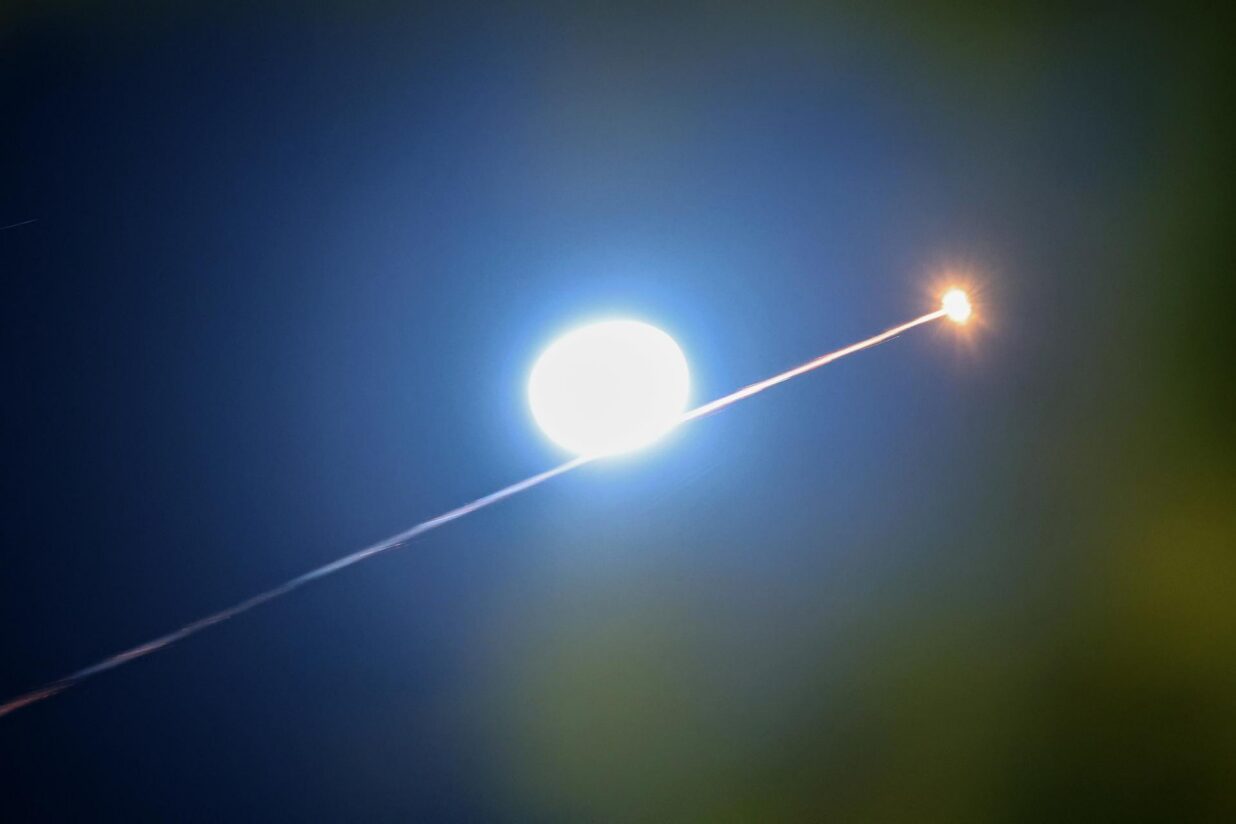

Poc després, al gener, Anthropic presentà al Pentàgon una proposta per a desenvolupar una tecnologia que, amb l’ajuda de Claude, sembla que va permetre als comandants de l’exèrcit de dirigir eixams de drons únicament amb instruccions verbals.

Tot això ha passat en un buit legal, i amb una tecnologia que se sap que té tirada a cometre errors; segons alguns experts, de fet, és possible que la tendència de la IA a “al·lucinar” –és a dir, a confabular i a inventar-se respostes– no es pugui mai resoldre del tot.

No seria la primera vegada que l’exèrcit nord-americà empra sistemes poc fiables de IA en un conflicte. Durant la guerra d’Israel a Gaza, per exemple, l’exèrcit nord-americà recorregué repetidament a Lavender, el banc de dades impulsat per intel·ligència artificial que havia d’ajudar a identificar objectius militars associats amb Hamàs a Gaza. El sistema es dedicava a analitzar grans quantitats de dades, com ara les connexions socials i l’historial de moviment, per a assignar a cada individu una puntuació de l’1 al 100. Quan la puntuació d’un individu superava un nivell determinat, Lavender passava a classificar-lo d’objectiu militar automàticament.

El problema era que Lavender s’equivocava en un 10% dels casos, segons una investigació publicada pel mitjà israeliano-palestí +972. “Prop de 3.600 persones van ser identificades com a objectiu, i atacades, per error”, explica Mariarosaria Taddeo, professora d’ètica digital i tecnologia de defensa a l’Internet Institute de la Universitat d’Oxford.

“Aquests sistemes tenen vulnerabilitats increïbles i són molt poc fiables […] i més en un àmbit tan dinàmic i voluble com la guerra”, diu Elke Schwarz, professora de teoria política de la Universitat Queen Mary de Londres.

Schwarz assenyala que els exèrcits sovint recorren a la IA al camp de batalla per a accelerar el procés de presa de decisions, cosa que pot menar a resultats no desitjats. Les decisions es prenen més de pressa, a escala més gran i amb menys supervisió humana. Aquesta darrera dècada i mitja, segons que diu, l’ús de la IA en l’àmbit militar ha esdevingut cada volta més opac.

Per si no n’hi hagués prou, el funcionament intern dels laboratoris de IA es regeix pel secretisme, fins i tot en els projectes no bèl·lics. Aquestes empreses no volen revelar amb quines dades entrenen els models ni quins processos fan servir per arribar a les conclusions a què arriben.

És clar que sovint cal que les operacions militars siguin confidencials per a protegir els soldats i evitar les represàlies enemigues. Però la guerra convencional és molt regulada pel dret internacional humanitari i les normes d’assaig d’armament, que en teoria –no pas a la pràctica– també haurien d’abordar l’ús de la IA.

Taddeo remarca que l’article 36 del Conveni de Ginebra exigeix que qualsevol arma nova es posi a prova abans de ser desplegada al camp de batalla. El problema és que un model de IA canvia cada volta que s’actualitza, cosa que fa gairebé impossible d’aplicar la norma.

En un món ideal, governs com el dels Estats Units revelarien com s’empren aquests sistemes en el camp de batalla. Hi ha un precedent: després dels atacs de l’11 de setembre de 2001, l’exèrcit nord-americà començà a emprar drons armats d’esquena al públic. L’ús de drons augmentà durant el govern Obama, que en un primer moment continuà negant l’existència del programa de drons de l’exèrcit.

Calgueren gairebé quinze anys de filtracions, pressió mediàtica i demandes judicials perquè la Casa Blanca acceptés de publicar –l’any 2016, encara amb Obama de president– les xifres de víctimes dels atacs amb drons. Els experts consideraren que les xifres publicades per Washington eren molt inferiors a les reals, però la publicació permeté al públic nord-americà, al congrés i als mitjans de comunicació d’exigir responsabilitats al govern per primera volta.

Controlar l’ús la IA serà encara més difícil, atesa la pressió que caldrà per a obligar el govern Trump –poc propens a la transparència– a prendre una decisió semblant.

L’objectiu, explica Schwarz, no seria revelar els detalls exactes de la implicació de Claude en els atacs dels darrers dies, sinó fer públiques les línies generals de la integració de la IA en les operacions de l’exèrcit i, sobretot, revelar quan les coses hagin anat malament.

La disputa entre Anthropic i el Pentàgon –que discrepen sobre la legalitat i l’ètica d’emprar la IA per a espiar els nord-americans o per a dirigir armes completament autònomes– passa per alt una qüestió més important: que la IA ja s’empra en el camp de batalla sense cap mena de supervisió. Tractant-se d’una tecnologia tan nova i amb tanta tirada a cometre errors, la revisió humana és especialment important. “Com a societat, encara no hem dit si ens sembla bé que una màquina decideixi si s’ha de matar un ésser humà o no”, afirma Taddeo.

Impulsar aquesta transparència és clau, sobretot abans que l’ús de la IA esdevingui tan habitual al camp de batalla que la gent ja ni ho prengui en consideració. Altrament, podríem córrer el risc de cometre errors catastròfics i de conseqüències imprevisibles.

- Subscribe to The Washington Post

- Podeu llegir més reportatges del Washington Post publicats en català a VilaWeb